开源DeepSeek推理引擎:推动AI基础设施的社区协作新篇章

近年来,人工智能(AI)技术的迅猛发展离不开开源社区的贡献。从操作系统到机器学习框架,开源运动为技术创新提供了肥沃的土壤。在这一背景下,DeepSeek公司宣布开源其推理引擎(DeepSeek Inference Engine)的计划,标志着AI基础设施领域的一次重要进展。本文将深入探讨DeepSeek推理引擎开源的意义、技术亮点以及对AI生态系统的潜在影响。

一、DeepSeek推理引擎的背景

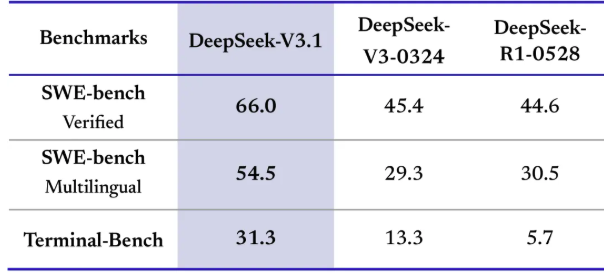

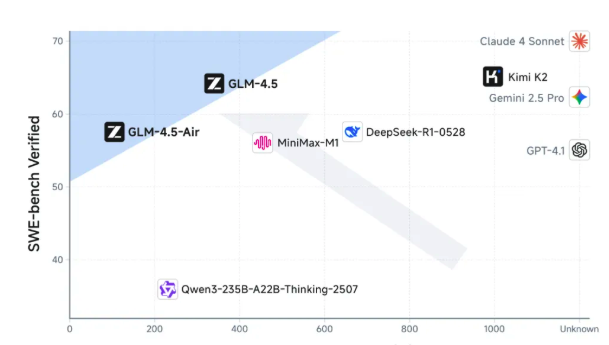

DeepSeek是一家总部位于中国杭州的人工智能研究公司,致力于开发高效的大型语言模型(LLM)。其旗舰模型DeepSeek-V3和DeepSeek-R1因性能卓越、成本低廉而广受关注。然而,模型的成功不仅依赖于算法设计,还需要强大的推理引擎来优化部署和运行效率。

DeepSeek的推理引擎最初基于vLLM(一个开源的高效推理框架)开发,但经过一年多的深度定制,引擎已经高度适配DeepSeek的模型架构和内部基础设施。这种定制化带来了显著的性能提升,但也导致了代码库与vLLM主线的分化以及对内部集群管理工具的依赖。为了让更广泛的社区受益,DeepSeek决定将其优化成果回馈开源生态,并通过与vLLM社区的协作,推动推理技术的进步。

二、开源计划的核心亮点

DeepSeek在其官方发布的《The Path to Open-Sourcing the DeepSeek Inference Engine》中详细阐述了开源路线图。以下是计划的几个关键亮点:

与vLLM社区的深度协作

DeepSeek并未选择直接发布一个独立的代码库,而是计划将其优化技术逐步贡献到vLLM的上游代码库。这种方式不仅避免了代码库碎片化,还能确保DeepSeek的创新成果被更广泛的AI开发者采用。例如,DeepSeek的推理引擎在处理高稀疏性混合专家模型(MoE)时,通过跨节点专家并行(Expert Parallelism)大幅提升了吞吐量和降低了延迟。这些优化将被整合到vLLM中,惠及所有基于vLLM的项目。

高效推理的技术创新

DeepSeek推理引擎针对大规模MoE模型(如DeepSeek-V3,拥有6710亿参数但每token仅激活370亿参数)进行了多项优化:

- 多头潜注意力(

Multi-Head Latent Attention, MLA):通过压缩键值对(KV Cache),显著降低了内存占用,同时保持长上下文处理能力。 - 动态负载均衡:引入无辅助损失的负载均衡策略,动态调整专家分配,避免计算资源浪费。

- 多token预测:通过一次性生成多个token,加速推理过程,特别适合实时应用场景。

FP8混合精度计算:利用8位浮点运算降低计算成本,同时维持模型精度。

社区驱动的标准化支持

DeepSeek承诺在新模型发布前,与开源社区和硬件合作伙伴同步推理相关的工程工作,确保社区能够在模型发布的第一天(Day-0)实现最优支持。这种”从零日开始”的协作模式将大大缩短新技术从实验室到实际应用的周期。

三、开源的意义与挑战

DeepSeek推理引擎的开源计划不仅体现了其对开放科学的承诺,也为AI生态系统带来了深远的影响:

降低AI开发门槛

通过共享高效推理技术,DeepSeek使得中小型研究团队和初创公司能够以更低的成本部署大型模型。这种”技术平民化”将加速AI在教育、医疗、能源等领域的应用。

推动行业协作

DeepSeek选择与vLLM社区合作,而非独自发布代码库,展现了其对生态系统整体发展的重视。这种协作模式有望成为AI基础设施开源的新范式,激励更多企业将内部技术贡献到公共领域。

应对技术挑战

尽管前景光明,但开源过程也面临挑战。例如,DeepSeek的推理引擎高度依赖其内部基础设施,如何剥离这些依赖并适配多样化的硬件环境是一个复杂问题。此外,vLLM社区需要协调不同贡献者的优化方案,以确保代码库的稳定性和通用性。

四、对AI生态系统的影响

DeepSeek推理引擎的开源将对AI生态系统产生多层次的影响:

加速模型部署效率

推理阶段是AI模型从训练到实际应用的关键环节。高效率的推理引擎能够显著降低运行成本,提升模型在边缘设备或云端的响应速度。DeepSeek的优化技术有望成为行业标杆,推动推理效率的整体提升。

促进硬件-软件协同设计

DeepSeek的成功得益于其在算法、框架和硬件之间的协同优化。开源推理引擎将为硬件厂商提供参考,激励他们设计更适配AI工作负载的芯片和系统。

增强开源社区活力

DeepSeek的贡献将进一步巩固开源社区在AI发展中的核心地位。无论是PyTorch、TensorFlow还是vLLM,这些开源框架的繁荣都离不开企业的积极参与。DeepSeek的加入无疑为社区注入了新的活力。

五、未来展望

DeepSeek推理引擎的开源计划只是其开放科学战略的一部分。未来,DeepSeek可能会进一步开源训练框架、数据处理工具或其他基础设施组件。与此同时,其与vLLM等项目的合作将为AI社区树立一个榜样:通过共享和协作,技术进步可以更快惠及全人类。

然而,开源并非没有争议。一些批评者担心,开源AI技术可能被滥用,例如用于生成虚假信息或恶意软件。因此,DeepSeek需要在开源的同时,加强对技术使用的道德指导和监管协作。

结语

DeepSeek推理引擎的开源计划是一次意义深远的尝试,它不仅展示了企业在技术创新上的雄心,也体现了开源社区在推动AI发展中的不可替代作用。通过与vLLM社区的紧密合作,DeepSeek正在为AI基础设施的未来铺平道路。正如DeepSeek在其声明中所说:“我们深知没有开源生态的繁荣,通向AGI的道路将举步维艰。“在这一旅程中,每一个代码贡献、每一次社区协作,都将成为迈向通用人工智能的重要一步。

(参考来源:DeepSeek官方发布《The Path to Open-Sourcing the DeepSeek Inference Engine》)

更多文章